Автоматизируйте запросы к большим языковым моделям с помощью Loginom. Разбирается способ подключения к ChatGPT с помощью коннектора API на платформе Loginom. С его помощью можно автоматизировать очистку текстов, извлечение смыслов, классификацию и другие задачи, связанные с LLM.

Искусственный интеллект (ИИ) все активнее внедряется в бизнес-аналитику и работу с данными. При решении некоторых задач это не просто модный тренд, а практичный инструмент. С помощью искусственного интеллекта можно автоматизировать рутинные операции и повышать точность аналитических решений. Под ИИ в данном контексте в первую очередь понимаются большие языковые модели (LLM).

На практике бизнесу все чаще требуется не просто «пообщаться» с моделью в чате, а встроить ее в существующие процессы. Например, реализовать интеллектуальный поиск, автоматическую классификацию и обогащение текстов, анализ комментариев, описаний или других документов. Ключевой момент здесь — автоматизация. Запросы к языковой модели должны формироваться системой, выполняться программно и возвращать результат обратно в аналитический контур без ручного копирования, желательно – вообще без участия пользователя.

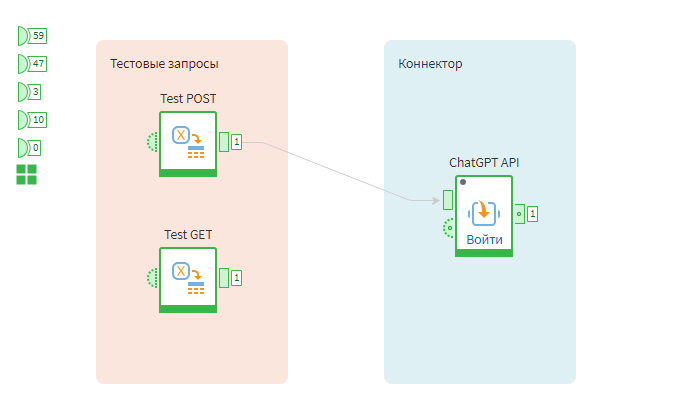

Взаимодействие Loginom и ChatGPT

В статье рассматривается способ интеграции Loginom с помощью коннектора API к ChatGPT. С помощью данного коннектора можно использовать возможности LLM непосредственно внутри аналитических Сценариев.

В файле chatgpt_api.lgp содержится готовый коннектор к ChatGPT API с примерами запросов.

Внешний вид Сценария

Важно:

Запросы в формате JSON подаются на входной порт «Таблица» и имеют следующую структуру:

{"model": "gpt-4", "input": "What is Loginom?"}В данном примере промпт для языковой модели — '"What is Loginom?"'. Показан минимальный набор параметров, при котором Сценарий будет работать. Полный список параметров запроса можно посмотреть в официальной документации к ChatGPT.

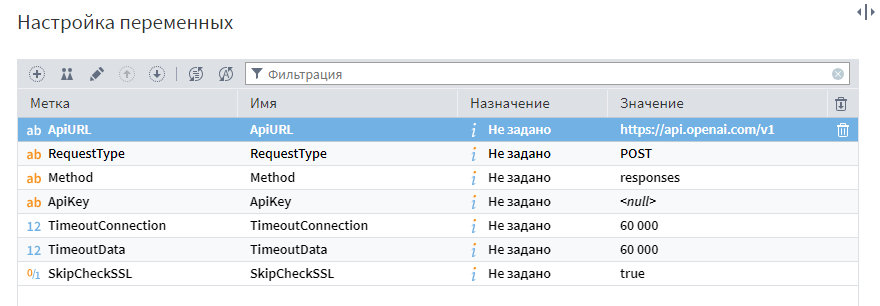

Во входном порте переменных находятся параметры для настройки работы коннектора.

Настройка переменных

Настройки параметров запроса показаны в таблице:

| Параметр | Описание |

|---|---|

| ApiURL | Корневой URL API OpenAI (по умолчанию: https://api.openai.com/v1) |

| RequestType | Тип HTTP-запроса (POST или GET) |

| Method | Метод API (например, responses). Полный список методов см. в документации OpenAI. |

| ApiKey | Ваш API-ключ OpenAI. Можно указать здесь или задать в переменной окружения OPENAI_API_KEY. Если этот параметр NULL, то система считывает информацию из OPENAI_API_KEY (Панель управления → Система → Дополнительные параметры системы → Переменные среды) |

| TimeoutConnection | Таймаут подключения (мс) — максимальное время установки TCP-соединения с сервером в миллисекундах, по истечении которого соединение будет прервано со статусом ошибки. Если параметр равен нулю, то таймаут не ограничен. |

| TimeoutData | Таймаут обмена данными (мс) — максимальное время, которое будет затрачено на отправку HTTP-запроса и получение ответа, по истечении которого обмен будет прерван со статусом ошибки. Если параметр равен нулю, то таймаут не ограничен. |

| SkipCheckSSL | Игнорировать ошибки SSL-сертификата — если установлено значение true, то ошибки при проверке сертификата сервера, к которому производится подключение, игнорируются. |

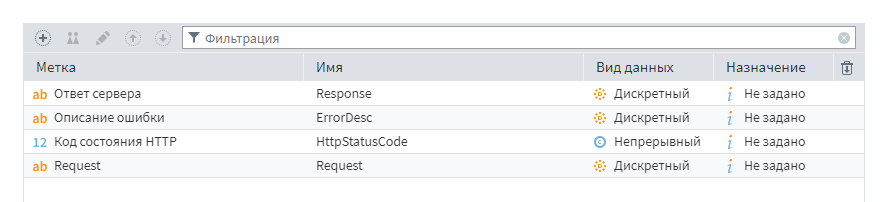

Выходная таблица содержит:

Настройка выходных полей показана на рисунке ниже.

Настройка выходных столбцов

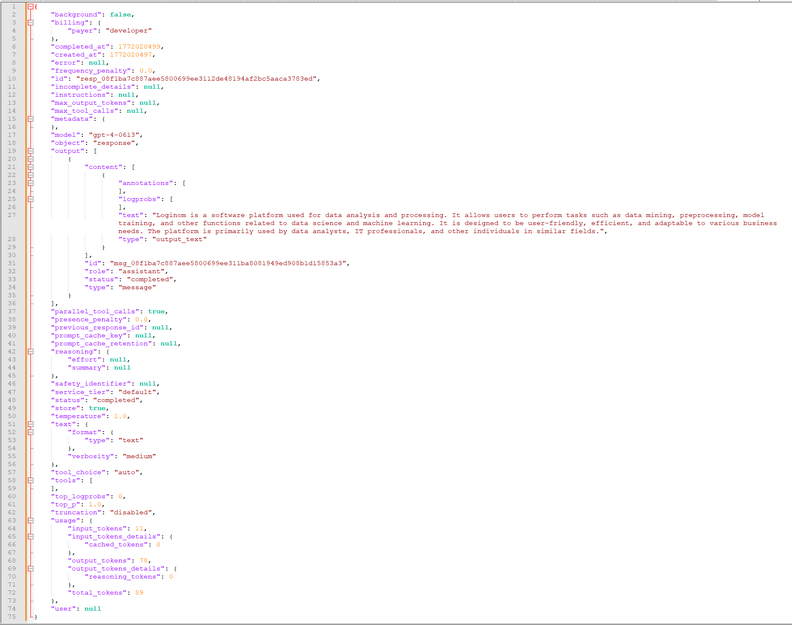

Ответ сервера приходит в формате JSON.

Ответ сервера в формате JSON

В данном примере получен ответ LLM: '"Loginom is a software platform used for data analysis and processing. It allows users to perform tasks such as data mining, preprocessing, model training, and other functions related to data science and machine learning. It is designed to be user-friendly, efficient, and adaptable to various business needs. The platform is primarily used by data analysts, IT professionals, and other individuals in similar fields."'

Остальной текст в формате JSON – технический: описание запроса, условий, ошибок и т.д.

Пошаговое описание взаимодействия с системой:

Демонстрация работы коннектора к ChatGPT:

При использовании ChatGPT API-коннектора Loginom позволяет подключаться к внешней большой языковой модели и применять ее возможности прямо в аналитических Сценариях. Это позволяет решать множество задач: обработка и анализ текстов, интеллектуальный поиск, генерация описаний, классификация данных, извлечение смыслов и многое другое — все в автоматическом режиме и в рамках единой платформы.

Важно и то, что описанный подход не ограничивается одной конкретной моделью. Аналогичным образом Сценарии Loginom могут быть адаптированы для работы и с другими LLM. Это делает решение гибким, позволяя выбирать и комбинировать языковые модели под конкретные бизнес-задачи.

Для оценки функционала платформы можно скачать бесплатную настольную версию Loginom здесь. Также можно запросить пробную серверную версию для организации, заполнив форму. Интеграция LLM в Loginom — это практичный способ использования возможностей современных языковых моделей в бизнес-аналитике.

Другие материалы по теме: